L’IA et l’équité : un nouveau cadre causal pour une évaluation plus juste des algorithmes

L’évaluation de l’équité dans les algorithmes d’apprentissage automatique est un défi crucial. Souvent, on se concentre sur la performance globale du modèle, ignorant les disparités potentielles entre les sous-groupes de la population. Prenons l’exemple du domaine médical : un algorithme de diagnostic pourrait être globalement performant, mais présenter des taux d’erreur significativement différents selon le sexe ou l’origine ethnique des patients. Ces inégalités peuvent avoir des conséquences graves.

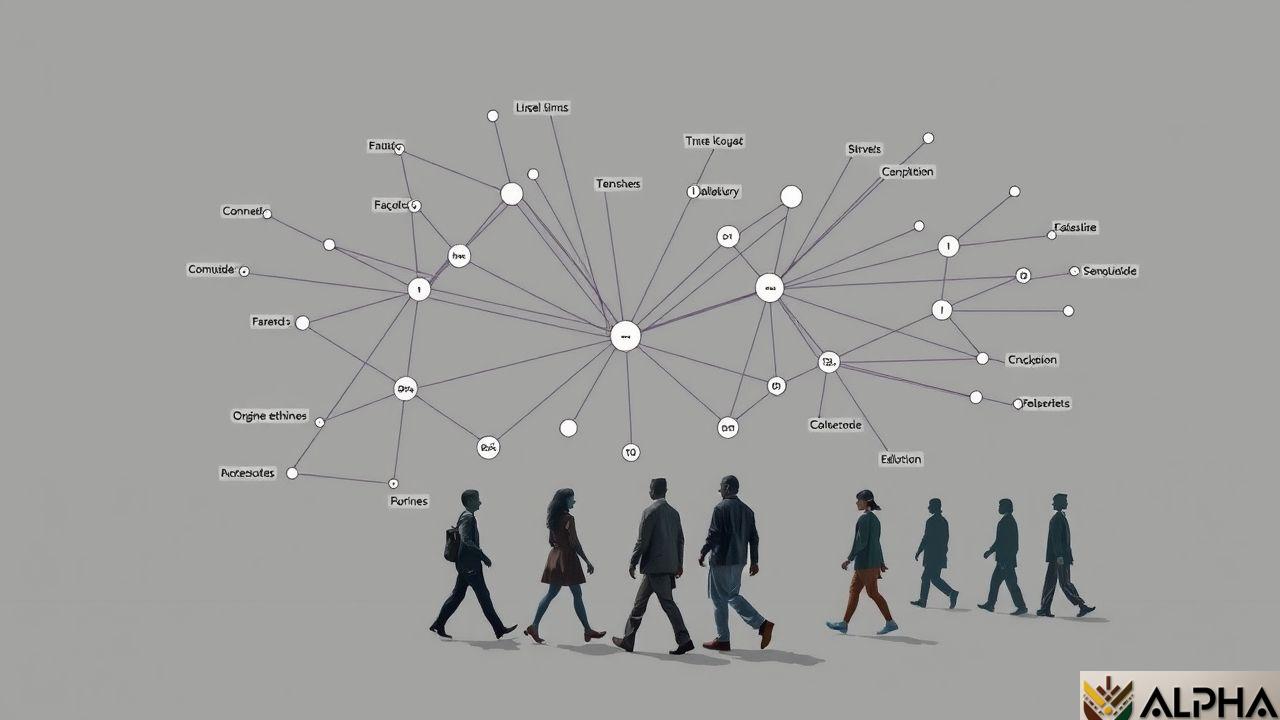

Une nouvelle approche, présentée dans un article de Google, propose un cadre causal pour interpréter l’équité des sous-groupes. Ce cadre permet d’analyser les causes des disparités de performance, allant au-delà d’une simple observation des différences statistiques. Au lieu de se contenter de constater des écarts de performance entre les groupes, ce cadre causal permet d’identifier les facteurs qui contribuent à ces écarts. Par exemple, il pourrait révéler que certaines caractéristiques démographiques sont corrélées à l’accès aux soins de santé, ce qui influe sur la performance du modèle et crée une apparence d’iniquité.

En Afrique, où les disparités socio-économiques sont souvent importantes, l’application de ce cadre causal est particulièrement pertinente. Imaginons un modèle prédictif pour l’agriculture : il pourrait prédire avec précision les rendements pour les agriculteurs ayant accès à des technologies modernes, mais moins bien pour ceux dans des régions rurales reculées, souffrant de manque d’infrastructures. Le cadre causal permettrait de démêler les facteurs liés à l’accès aux technologies de ceux qui sont intrinsèquement liés aux performances agricoles. L’analyse pourrait ainsi identifier les biais liés à la disponibilité des données, et non à des différences de compétences.

Ce type d’analyse permet de concevoir des algorithmes plus justes et plus équitables. En identifiant les causes profondes des disparités, il est possible de concevoir des interventions ciblées pour améliorer la performance du modèle pour tous les sous-groupes. Cela nécessite de prendre en compte les aspects socio-économiques et les contextes spécifiques. L’objectif n’est pas seulement de corriger les résultats, mais de comprendre et de traiter les facteurs sous-jacents de l’inégalité.

En conclusion, ce nouveau cadre causal offre une approche plus nuancée et plus précise pour évaluer et améliorer l’équité des algorithmes. Son application en Afrique et dans d’autres contextes caractérisés par de fortes disparités sociales pourrait contribuer à la création de systèmes d’IA réellement inclusifs et bénéfiques pour tous.

Share this content:

Laisser un commentaire